AMD Bicara Soal Persiapan untuk Revolusi AI Agentik!

AI Agentik berbeda dengan model AI tradisional

Effisiensi optimal GPU dan konektivitas yang penting dalam mendukung sistem AI

AMD ROCm memberi kebebasan untuk membangun, mengoptimalkan, dan menerapkan model AI di berbagai lingkungan

AMD bicara soal kehadiran Agentic AI yang makin relevan dalam perkembangan teknologi! Seperti apa ungkapannya? Temukan di sini!

1. AI Agentif

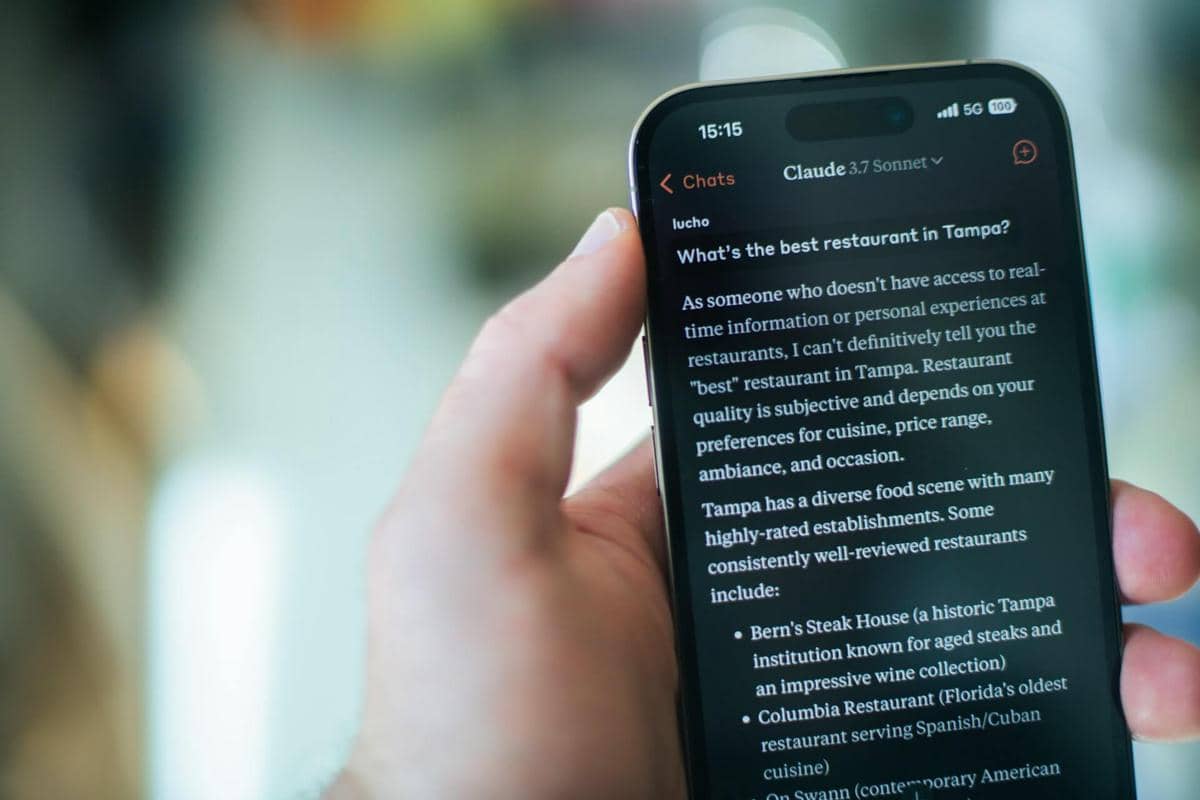

Berbeda dengan model AI tradisional, AI agenik tidak hanya merespons pertanyaan – ia bernalar, merencanakan, dan mengambil tindakan di berbagai sistem. Misalnya, alih-alih hanya menjawab pertanyaan tentang rekomendasi perjalanan, sistem agenik akan memesan penerbangan, memperbarui kalender, mengirim pengingat, dan bahkan menyesuaikan rencana perjalanan berdasarkan cuaca atau penundaan – semuanya tanpa diminta untuk setiap langkahnya. Ini menandai pergeseran dari respons AI pasif ke sistem proaktif dan kolaboratif yang bekerja bersama manusia. Munculnya AI agenik akan membutuhkan daya komputasi yang jauh lebih besar – tidak hanya untuk tugas atau pertanyaan tunggal, tetapi untuk alur kerja yang lebih luas yang melibatkan penalaran, perencanaan, dan adaptasi berkelanjutan.

"Di era AI berbasis agen, desain sistem heterogen menjadi sangat penting. Infrastruktur AI harus melampaui komputasi mentah – infrastruktur tersebut harus mengintegrasikan CPU, GPU, jaringan, dan memori secara fleksibel dan terukur. Sistem yang dibangun dengan cara ini dapat memberikan kecepatan, koordinasi, dan throughput yang dibutuhkan untuk mendukung interaksi real-time yang cepat dari miliaran agen cerdas. Seiring dengan meningkatnya adopsi, optimasi tingkat rak di mana komputasi, penyimpanan, dan jaringan dirancang bersama secara erat akan menjadi kunci untuk menghadirkan gelombang kinerja dan efisiensi berikutnya. Hal yang sama pentingnya adalah keterbukaan di tingkat perangkat keras dan sistem. Seiring dengan evolusi komputasi AI menuju penyebaran heterogen skala besar, arsitektur skala rak menjadi fundamental," kata Alexey Navolokin, General Manager, APAC, AMD

2. Efisiensi optimal GPU

Graphics Processing Units (GPU) berkinerja tinggi sering mendominasi percakapan tentang AI, terutama untuk melatih dan menjalankan model skala besar. Tetapi central processing units (CPU) sama pentingnya dalam mendukung sistem AI di balik layar – menangani tugas-tugas penting seperti perpindahan data, manajemen memori, koordinasi thread, dan mengatur beban kerja GPU. Faktanya, banyak beban kerja AI – termasuk model bahasa dengan hingga 13 miliar parameter, pengenalan gambar, deteksi penipuan, dan sistem rekomendasi, dapat berjalan secara efisien pada server yang hanya menggunakan CPU, terutama jika didukung oleh CPU berkinerja tinggi seperti prosesor AMD EPYC 9005 Series.

Sama pentingnya adalah konektivitas, "perekat" yang menyatukan sistem AI modern. Komponen jaringan canggih, seperti network interface controllers (NIC) cerdas, membantu mengarahkan data secara efisien dan aman antar komponen, mengurangi beban lalu lintas dari GPU dan mengurangi latensi. Interkoneksi berkecepatan tinggi dan latensi rendah membantu memastikan aliran data lancar di seluruh sistem, sementara infrastruktur yang dapat diskalakan menghubungkan node menjadi klaster AI terdistribusi yang andal.

3. Kebebasan dalam menerapkannya

AMD ROCm memberi pengembang dan peneliti kebebasan untuk membangun, mengoptimalkan, dan menerapkan model AI di berbagai lingkungan. Ia mendukung kerangka kerja populer seperti PyTorch dan TensorFlow, menyertakan alat canggih untuk penyetelan kinerja, dan menawarkan portabilitas di berbagai hardware – semuanya tersedia sebagai open source. Dalam konteks ambisi Jepang untuk mendorong inovasi di seluruh akademisi, perusahaan rintisan, dan industri, open AI software menawarkan aksesibilitas yang lebih luas, iterasi yang lebih cepat, dan hambatan yang lebih rendah.

Seiring berkembangnya komputasi AI menuju penerapan skala besar dan heterogen, arsitektur skala rak menjadi sangat mendasar. Standar terbuka seperti Open Compute Project (OCP) mendukung desain sistem modular, sementara kolaborasi yang muncul seperti Ultra Accelerator Link (UALink) bertujuan untuk menciptakan koneksi terbuka dan berbandwidth tinggi antara akselerator AI di berbagai server. Sementara itu, Ultra Ethernet Consortium (UEC) sedang mendefinisikan standar jaringan generasi berikutnya yang dirancang khusus untuk AI – memungkinkan pergerakan data dengan latensi rendah dan throughput tinggi di seluruh sistem terdistribusi.

Apa pendapatmu sendiri terhadap AMD dan penghasutan teknologi dan kualitasnya? Sampaikan melalui kolom komentar!